CogVideoX1.5-5B-SAT官网

CogVideoX1.5-5B-SAT是由清华大学知识工程与数据挖掘团队开发的开源视频生成模型,是CogVideoX模型的升级版。该模型支持生成10秒视频,并支持更高分辨率的视频生成。模型包含Transformer、VAE和Text Encoder等模块,能够根据文本描述生成视频内容。CogVideoX1.5-5B-SAT模型以其强大的视频生成能力和高分辨率支持,为视频内容创作者提供了一个强大的工具,尤其在教育、娱乐和商业领域有着广泛的应用前景。

CogVideoX1.5-5B-SAT是什么

CogVideoX1.5-5B-SAT是由清华大学团队开发的开源视频生成模型,是CogVideoX的升级版。它能根据文本描述生成时长最多10秒的高分辨率视频。该模型包含Transformer、VAE和Text Encoder等模块,支持文本转视频(T2V)功能,并具有强大的视频生成能力,在教育、娱乐和商业领域都有广泛的应用前景。

CogVideoX1.5-5B-SAT主要功能

CogVideoX1.5-5B-SAT的主要功能是根据文本提示生成视频。其核心功能包括:文本到视频的转换(T2V),支持生成最高10秒的视频,并能生成更高分辨率的视频。 模型集成了图像到视频(I2V)和文本到视频(T2V)模型的权重,方便用户使用。

如何使用CogVideoX1.5-5B-SAT

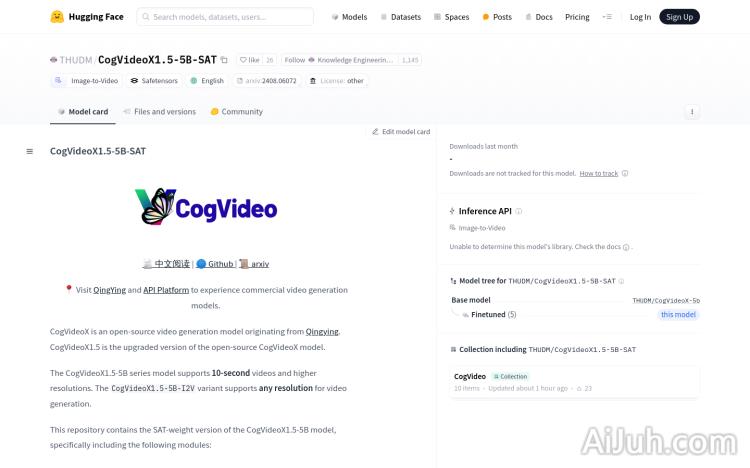

使用CogVideoX1.5-5B-SAT,你需要按照以下步骤操作:1. 访问Hugging Face平台,搜索并下载CogVideoX1.5-5B-SAT模型及其权重;2. 配置好运行环境和必要的依赖项(参考模型文档);3. 使用文本描述作为输入,调用模型生成视频;4. 根据需要调整模型参数,优化视频生成效果。整个过程需要一定的技术基础,熟悉Python编程和深度学习框架。

CogVideoX1.5-5B-SAT产品价格

CogVideoX1.5-5B-SAT是一个开源模型,这意味着它是免费的。你可以下载和使用,但需要遵守CogVideoX LICENSE授权协议。

CogVideoX1.5-5B-SAT常见问题

这个模型对电脑配置有什么要求? 运行CogVideoX1.5-5B-SAT需要一台配置较高的电脑,拥有强大的GPU显存是必要的。具体配置要求请参考模型的官方文档。

生成的视频质量如何? 视频质量取决于输入文本的描述精度和模型参数的调整。高质量的文本描述通常能生成更高质量的视频。模型本身也支持高分辨率视频生成,但生成过程可能比较耗时。

如果遇到错误该如何解决? 遇到错误时,首先检查你的环境配置是否正确,其次查看模型的官方文档和社区论坛,寻求帮助或查找解决方案。你也可以尝试简化输入文本,或者调整模型参数。

CogVideoX1.5-5B-SAT官网入口网址

https://huggingface.co/THUDM/CogVideoX1.5-5B-SAT

OpenI小编发现CogVideoX1.5-5B-SAT网站非常受用户欢迎,请访问CogVideoX1.5-5B-SAT网址入口试用。

数据统计

数据评估

本站Home提供的CogVideoX1.5-5B-SAT都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由Home实际控制,在2025年 1月 9日 下午9:58收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,Home不承担任何责任。