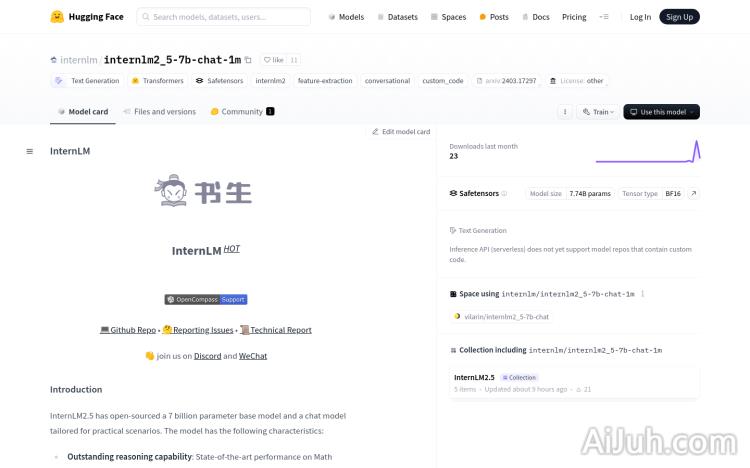

InternLM2.5-7B-Chat-1M官网

70亿参数的超长上下文对话模型

InternLM2.5-7B-Chat-1M简介

需求人群:

"目标受众包括需要处理大量文本数据的研究人员和开发者,以及希望利用AI进行复杂对话和推理的企业和个人。"

使用场景示例:

研究人员使用模型进行数学问题解答

企业利用模型进行客户服务的自动化对话

开发者通过模型实现个性化的机器人

产品特色:

支持1M超长上下文窗口,适合长文本任务处理

在数学推理方面具有同量级模型最优精度

工具调用能力升级,支持多轮调用完成复杂任务

支持从上百个网页搜集信息进行分析推理

通过LMDeploy和Transformers进行本地和流式生成推理

与vLLM兼容,可启动兼容OpenAI API的服务

使用教程:

1. 安装必要的库,如torch和transformers。

2. 使用AutoTokenizer和AutoModelForCausalLM从Hugging Face加载模型。

3. 设置模型精度为torch.float16以避免显存不足。

4. 通过chat或stream_chat接口与模型进行交互。

5. 使用LMDeploy进行1M超长上下文的本地批量推理。

6. 利用vLLM启动兼容OpenAI API的服务,进行更高级的模型部署。

InternLM2.5-7B-Chat-1M官网入口网址

小编发现InternLM2.5-7B-Chat-1M网站非常受用户欢迎,请访问InternLM2.5-7B-Chat-1M网址入口试用。

数据统计

数据评估

关于InternLM2.5-7B-Chat-1M特别声明

本站Home提供的InternLM2.5-7B-Chat-1M都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由Home实际控制,在2024年 7月 4日 下午9:22收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,Home不承担任何责任。

相关导航

暂无评论...