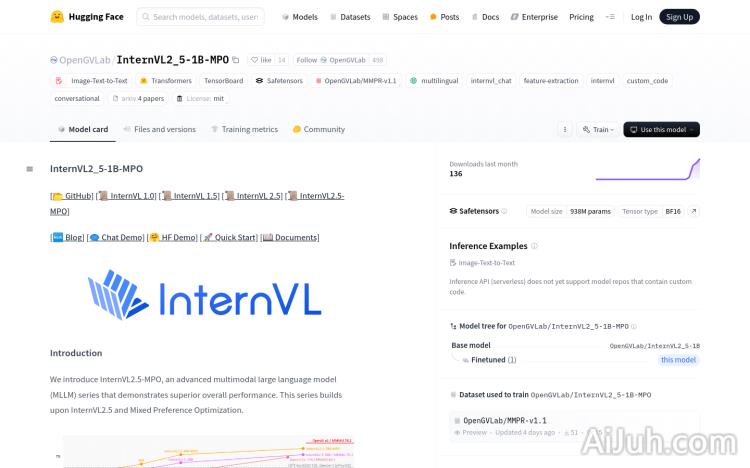

InternVL2_5-1B-MPO官网

InternVL2_5-1B-MPO是一个多模态大型语言模型(MLLM),它基于InternVL2.5和混合偏好优化(MPO)构建,展示了优越的整体性能。该模型集成了新增量预训练的InternViT与各种预训练的大型语言模型(LLMs),包括InternLM 2.5和Qwen 2.5,使用随机初始化的MLP投影器。InternVL2.5-MPO在模型架构上保留了与InternVL 2.5及其前身相同的“ViT-MLP-LLM”范式,并引入了对多图像和视频数据的支持。该模型在多模态任务中表现出色,能够处理包括图像描述、视觉问答等多种视觉语言任务。

InternVL2_5-1B-MPO是什么

InternVL2_5-1B-MPO是一个强大的多模态大型语言模型(MLLM),它能够理解和处理图像、视频以及文本信息。它基于InternVL2.5架构,并结合了混合偏好优化(MPO)技术,在图像描述、视觉问答等多模态任务上展现出优异的性能。该模型整合了InternViT和多个预训练大型语言模型(如InternLM 2.5和Qwen 2.5),并采用“ViT-MLP-LLM”的模型架构,高效地整合视觉和语言信息。InternVL2_5-1B-MPO还具备动态分辨率策略和像素重组操作,能够有效处理高分辨率图像和视频,并提升处理效率。

InternVL2_5-1B-MPO主要功能

InternVL2_5-1B-MPO的主要功能包括:图像描述生成、视觉问答、视频内容摘要、多模态信息理解等。它可以根据图像或视频内容生成详细的描述性文本,回答与图像或视频相关的问题,并提取视频中的关键信息生成摘要。其多模态能力使其能够在各种视觉语言任务中发挥作用。

如何使用InternVL2_5-1B-MPO

使用InternVL2_5-1B-MPO需要以下步骤:首先安装必要的库,如torch和transformers;然后从Hugging Face加载模型:`model = AutoModel.from_pretrained(‘OpenGVLab/InternVL2_5-1B-MPO’)`;接着准备输入数据,对图像进行预处理(例如调整大小和归一化);使用tokenizer将文本转换为模型可理解的格式;将处理后的图像和文本输入模型进行推理;最后对模型输出进行后处理,获取最终结果。对于多图像或视频数据,需要将多个图像块或帧合并,并在输入时提供额外的上下文信息。

InternVL2_5-1B-MPO产品价格

本文档未提供InternVL2_5-1B-MPO的价格信息。 要了解价格,请访问Hugging Face或OpenGVLab的官方网站。

InternVL2_5-1B-MPO常见问题

该模型的处理速度如何? 处理速度取决于输入数据的规模和硬件配置。 较大的图像或视频以及更强大的硬件将导致更快的处理速度。

模型的输出结果准确性如何? 模型的准确性取决于输入数据的质量和任务的复杂性。 对于清晰的图像和简单的任务,模型通常能够提供准确的结果。 对于模糊的图像或复杂的任务,准确性可能会降低。

如何处理模型输出的错误? 模型输出可能包含错误或不准确的信息。 建议在使用模型输出时进行人工审核和验证,并根据实际情况进行调整和改进。

InternVL2_5-1B-MPO官网入口网址

https://huggingface.co/OpenGVLab/InternVL2_5-1B-MPO

OpenI小编发现InternVL2_5-1B-MPO网站非常受用户欢迎,请访问InternVL2_5-1B-MPO网址入口试用。

数据统计

数据评估

本站Home提供的InternVL2_5-1B-MPO都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由Home实际控制,在2025年 1月 9日 下午11:06收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,Home不承担任何责任。