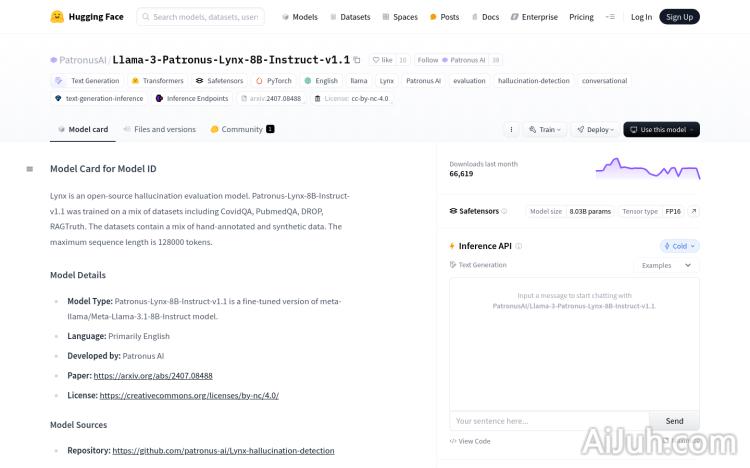

Llama-3-Patronus-Lynx-8B-Instruct-v1.1官网

Patronus-Lynx-8B-Instruct-v1.1是基于meta-llama/Meta-Llama-3.1-8B-Instruct模型的微调版本,主要用于检测RAG设置中的幻觉。该模型经过CovidQA、PubmedQA、DROP、RAGTruth等多个数据集的训练,包含人工标注和合成数据。它能够评估给定文档、问题和答案是否忠实于文档内容,不提供超出文档范围的新信息,也不与文档信息相矛盾。

Llama-3-Patronus-Lynx-8B-Instruct-v1.1是什么

Llama-3-Patronus-Lynx-8B-Instruct-v1.1是一个开源的幻觉评估模型,基于Meta Llama 3.1-8B-Instruct模型微调而来。它主要用于检测在检索增强生成(RAG)设置中大型语言模型生成的答案是否忠实于源文档。该模型经过多个数据集(包括CovidQA、PubmedQA、DROP和RAGTruth)的训练,能够判断答案是否与文档内容一致,避免模型产生脱离文档内容的“幻觉”。简单来说,它就像一个“事实核查员”,帮助确保AI生成的答案准确可靠。

Llama-3-Patronus-Lynx-8B-Instruct-v1.1的主要功能

Llama-3-Patronus-Lynx-8B-Instruct-v1.1 的核心功能是幻觉检测,它可以评估给定文档、问题和答案三者之间的一致性。除此之外,它还具备文本生成能力,可以根据问题和文档生成答案。模型以格式进行训练,使其更适合于对话式应用场景。

如何使用Llama-3-Patronus-Lynx-8B-Instruct-v1.1

使用该模型需要借助Hugging Face的pipeline接口。首先,准备包含问题、文档和答案的输入数据,并按照模型推荐的prompt格式组织数据。然后,调用Hugging Face的pipeline接口,传入模型名称和参数,并将准备好的数据作为输入。模型会输出’PASS’或’FAIL’的评分和推理过程,帮助用户判断答案是否忠实于文档。用户可以根据需要调整模型参数来优化性能。

Llama-3-Patronus-Lynx-8B-Instruct-v1.1的产品价格

Llama-3-Patronus-Lynx-8B-Instruct-v1.1 是一个开源模型,这意味着它是免费的,用户可以使用和修改,但需遵守cc-by-nc-4.0许可。

Llama-3-Patronus-Lynx-8B-Instruct-v1.1的常见问题

该模型能够处理多长文本? 该模型支持最大128000个token的序列长度,能够处理相当长的文档。

如何提高模型的准确性? 可以尝试调整模型参数,例如调整阈值,或者使用更规范的prompt工程技术来提高准确性。此外,使用高质量的训练数据也很重要。

该模型适用于哪些类型的文档? 该模型适用于各种类型的文档,包括但不限于医学文献、金融报告、新闻报道等,只要文档内容清晰且结构良好。

Llama-3-Patronus-Lynx-8B-Instruct-v1.1官网入口网址

https://huggingface.co/PatronusAI/Llama-3-Patronus-Lynx-8B-Instruct-v1.1

OpenI小编发现Llama-3-Patronus-Lynx-8B-Instruct-v1.1网站非常受用户欢迎,请访问Llama-3-Patronus-Lynx-8B-Instruct-v1.1网址入口试用。

数据统计

数据评估

本站Home提供的Llama-3-Patronus-Lynx-8B-Instruct-v1.1都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由Home实际控制,在2025年 1月 9日 下午8:39收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,Home不承担任何责任。