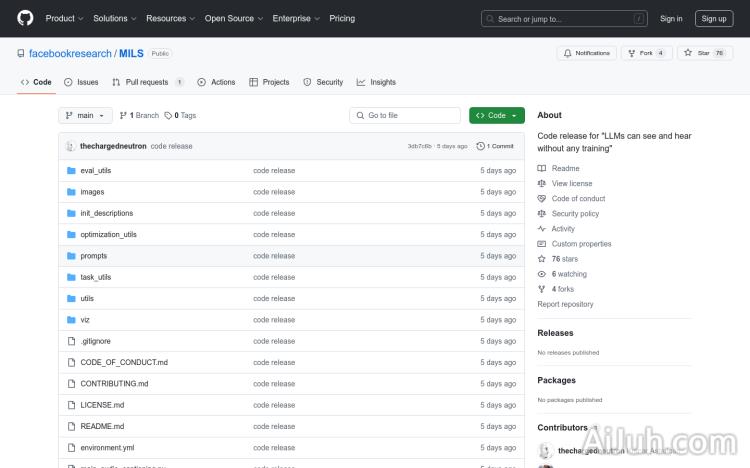

MILS官网

MILS是一个由Facebook Research发布的开源项目,旨在展示大型语言模型(LLMs)在未经过任何训练的情况下,能够处理视觉和听觉任务的能力。该技术通过利用预训练的模型和优化算法,实现了对图像、音频和视频的自动描述生成。这一技术突破为多模态人工智能的发展提供了新的思路,展示了LLMs在跨模态任务中的潜力。该模型主要面向研究人员和开发者,为他们提供了一个强大的工具来探索多模态应用。目前该项目是免费开源的,旨在推动学术研究和技术发展。

MILS是什么?

MILS是由Facebook Research发布的开源项目,旨在展示大型语言模型(LLMs)在无需额外训练的情况下处理图像、音频和视频的能力。它通过利用预训练模型和优化算法,自动生成对多模态数据的描述。这是一个强大的工具,为研究人员和开发者提供了探索多模态应用的途径。

MILS的主要功能

MILS的主要功能是自动生成图像、音频和视频的描述。它支持多种数据集,例如MS-COCO、Clotho和MSR-VTT。MILS利用预训练模型,优化了跨模态任务的性能,并支持多GPU并行处理,提高了生成效率。

如何使用MILS?

MILS的使用相对简单,步骤如下:1. 安装依赖环境(使用`conda env create -f environment.yml`);2. 下载并解压所需数据集;3. 更新`paths.py`文件中的路径配置;4. 选择对应脚本运行(例如,`main_image_captioning.py`用于图像描述生成);5. 使用评估脚本计算性能指标(如BLEU、METEOR)。

MILS的产品价格

MILS是一个开源项目,完全免费。

MILS的常见问题

MILS的系统要求是什么? MILS需要一定的计算资源,具体要求取决于数据集大小和使用的模型。建议参考官方GitHub仓库中的说明。

MILS支持哪些类型的多模态数据? MILS目前支持图像、音频和视频数据。未来可能会支持更多类型的数据。

如何评估MILS生成的描述质量? MILS提供了一些常用的评估指标,例如BLEU和METEOR。用户也可以根据自己的需求选择其他的评估方法。

MILS官网入口网址

https://github.com/facebookresearch/MILS

OpenI小编发现MILS网站非常受用户欢迎,请访问MILS网址入口试用。

数据统计

数据评估

本站Home提供的MILS都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由Home实际控制,在2025年 2月 7日 上午11:09收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,Home不承担任何责任。