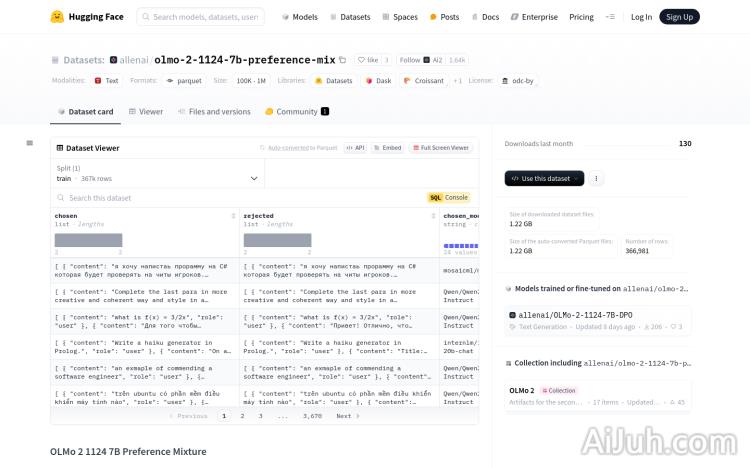

OLMo 2 1124 7B Preference Mixture官网

OLMo 2 1124 7B Preference Mixture 是一个大规模的文本数据集,由 Hugging Face 提供,包含366.7k个生成对。该数据集用于训练和微调自然语言处理模型,特别是在偏好学习和用户意图理解方面。它结合了多个来源的数据,包括SFT混合数据、WildChat数据以及DaringAnteater数据,覆盖了广泛的语言使用场景和用户交互模式。

OLMo 2 1124 7B Preference Mixture是什么

OLMo 2 1124 7B Preference Mixture是一个大型文本数据集,由Hugging Face提供,包含366,700个生成对。它汇集了来自SFT混合数据、WildChat数据和DaringAnteater数据的资料,涵盖了各种语言使用场景和用户交互模式。这个数据集主要用于训练和微调自然语言处理模型,尤其擅长于偏好学习和用户意图理解。

OLMo 2 1124 7B Preference Mixture的主要功能

OLMo 2 1124 7B Preference Mixture 的核心功能是提供一个庞大的、多样化的文本数据集,用于训练和改进自然语言处理模型。它能够帮助开发者构建更精准地理解用户偏好和意图的模型。具体功能包括:支持偏好学习模型的构建;支持自然语言处理模型的训练和微调;适用于研究用户意图和偏好的混合;适用于各种自然语言处理任务,如文本分类、情感分析等。

如何使用OLMo 2 1124 7B Preference Mixture

使用OLMo 2 1124 7B Preference Mixture 的步骤相对简单:首先,从Hugging Face数据集页面下载所需的数据集文件;然后,选择合适的模型和工具来处理数据集(例如,使用Python和相关的NLP库);接下来,使用数据集训练或微调你的自然语言处理模型;之后,分析模型输出,并调整参数以优化性能;最后,将训练好的模型应用于实际问题,例如开发机器人或进行文本分析。 在整个过程中,可能需要对数据集进行预处理和清洗,并记录实验结果,以便迭代改进模型。

OLMo 2 1124 7B Preference Mixture产品价格

OLMo 2 1124 7B Preference Mixture 数据集本身是免费提供的,可以通过Hugging Face平台访问和下载。但是,使用该数据集进行模型训练和部署可能需要一定的计算资源,这部分成本需要根据实际情况而定。

OLMo 2 1124 7B Preference Mixture常见问题

该数据集适合哪些类型的自然语言处理任务? 该数据集非常适合偏好学习、用户意图理解、对话系统构建等任务,也适用于需要理解细微语言差异的任务。

数据集的许可证是什么? 该数据集遵循ODC-BY许可,允许用于研究和教育用途。

如何处理数据集中的噪声数据? 在使用该数据集之前,建议进行数据清洗和预处理,例如去除重复数据、处理缺失值等。可以使用各种数据清洗技术和工具来实现。

OLMo 2 1124 7B Preference Mixture官网入口网址

https://huggingface.co/datasets/allenai/olmo-2-1124-7b-preference-mix

OpenI小编发现OLMo 2 1124 7B Preference Mixture网站非常受用户欢迎,请访问OLMo 2 1124 7B Preference Mixture网址入口试用。

数据统计

数据评估

本站Home提供的OLMo 2 1124 7B Preference Mixture都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由Home实际控制,在2025年 1月 9日 下午9:22收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,Home不承担任何责任。