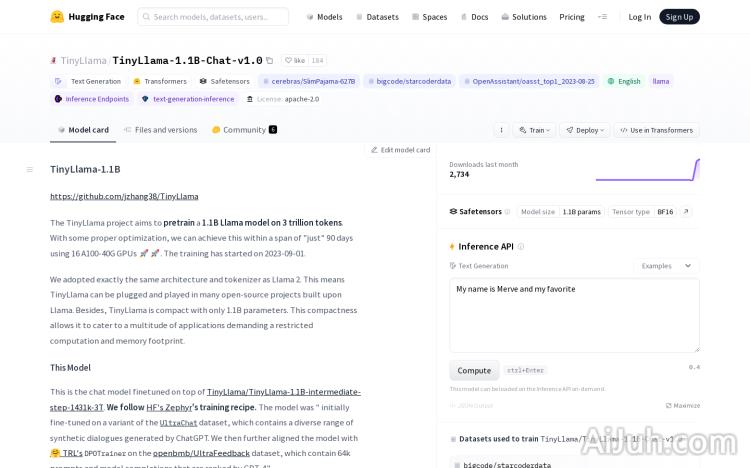

TinyLlama官网

TinyLlama项目旨在在3万亿令牌上预训练一个1.1B Llama模型。通过一些适当的优化,我们可以在“仅”90天内使用16个A100-40G GPU完成。训练已于2023-09-01开始。

TinyLlama简介

需求人群:

"TinyLlama可用于模型的微调和文本生成。"

使用场景示例:

https://github.com/jzhang38/TinyLlama

https://huggingface.co/docs/transformers/main/en/chat_templating

https://github.com/huggingface/transformers.git

产品特色:

文本生成

Transformers

安全张量

TinyLlama官网入口网址

https://huggingface.co/TinyLlama/TinyLlama-1.1B-Chat-v1.0

小编发现TinyLlama网站非常受用户欢迎,请访问TinyLlama网址入口试用。

数据统计

数据评估

关于TinyLlama特别声明

本站Home提供的TinyLlama都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由Home实际控制,在2024年 1月 10日 下午7:09收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,Home不承担任何责任。

相关导航

暂无评论...