UniMuMo官网

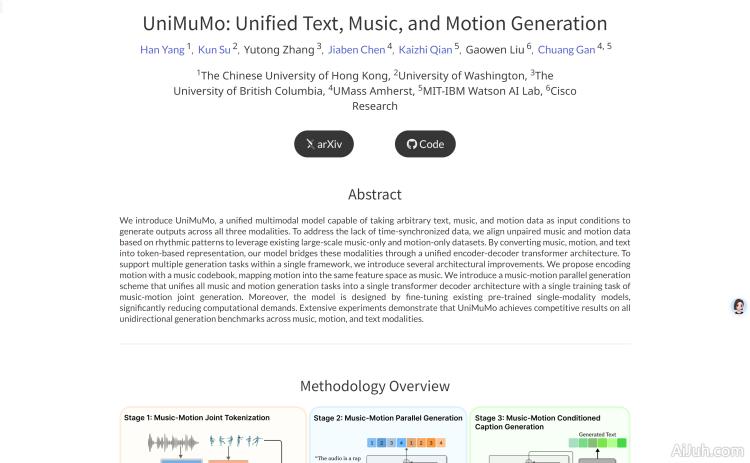

UniMuMo是一个多模态模型,能够将任意文本、音乐和动作数据作为输入条件,生成跨所有三种模态的输出。该模型通过将音乐、动作和文本转换为基于令牌的表示,通过统一的编码器-解码器转换器架构桥接这些模态。它通过微调现有的单模态预训练模型,显著降低了计算需求。UniMuMo在音乐、动作和文本模态的所有单向生成基准测试中都取得了有竞争力的结果。

UniMuMo是什么?

UniMuMo是一款多模态人工智能模型,它能够将文本、音乐和动作数据作为输入,并生成涵盖这三种模态的输出结果。这意味着你可以用文字描述生成音乐和舞蹈动作,或者用一段音乐生成相应的文字描述和动作等等。它通过将不同模态的数据转换为统一的标记表示,再利用编码器-解码器架构进行转换,实现跨模态的生成。UniMuMo的优势在于它利用预训练的单模态模型进行微调,有效降低了计算成本,并取得了不错的生成效果。

UniMuMo的主要功能

UniMuMo的核心功能在于其多模态生成能力。它可以根据用户的输入,生成跨越文本、音乐和动作三种模态的输出。例如,你可以输入一段文字描述,UniMuMo就能生成相应的音乐和舞蹈动作;或者输入一段音乐,UniMuMo可以生成相应的文字描述和与音乐节奏匹配的动作。这种跨模态的生成能力为创意工作者提供了强大的工具,可以帮助他们更高效地实现创意。

如何使用UniMuMo?

使用UniMuMo非常简单。首先,访问UniMuMo的在线演示页面(https://hanyangclarence.github.io/unimumo_demo/)。然后,选择你想要输入的模态(文本、音乐或动作),输入相应的数据,提交后等待模型生成结果即可。你可以根据需要调整输入数据或参数,多次尝试以获得更满意的结果。

UniMuMo的产品价格

目前,UniMuMo的在线演示是免费使用的。关于其商业化应用和价格信息,请访问官网或联系相关开发者获取更多信息。

UniMuMo的常见问题

UniMuMo的生成结果准确性如何? UniMuMo的生成结果取决于输入数据的质量和模型的训练情况。虽然在基准测试中取得了不错的成绩,但生成的音乐和动作可能并非完美,需要用户进行一定的调整和润色。

UniMuMo支持哪些类型的音乐和动作数据? UniMuMo支持多种类型的音乐和动作数据,具体支持的格式请参考官网说明。

如果生成的音乐或动作不满意,可以如何改进? 你可以尝试修改输入数据,例如调整文本描述的细节,或者选择不同的音乐风格或动作类型。也可以尝试调整模型的参数,以获得不同的生成结果。

UniMuMo官网入口网址

https://hanyangclarence.github.io/unimumo_demo/

OpenI小编发现UniMuMo网站非常受用户欢迎,请访问UniMuMo网址入口试用。

数据统计

数据评估

本站Home提供的UniMuMo都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由Home实际控制,在2025年 1月 10日 上午6:18收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,Home不承担任何责任。