VideoLLaMA 2官网

VideoLLaMA 2 是一个针对视频理解任务优化的大规模语言模型,它通过先进的空间-时间建模和音频理解能力,提升了对视频内容的解析和理解。该模型在多选视频问答和视频字幕生成等任务上展现了卓越的性能。

VideoLLaMA 2是什么

VideoLLaMA 2是一个强大的视频理解大型语言模型,由DAMO-NLP-SG团队开发。它能够理解视频内容,并完成诸如视频问答和字幕生成等任务。其核心优势在于先进的空间-时间建模和音频理解能力,使其在视频理解领域表现出色。

VideoLLaMA 2主要功能

VideoLLaMA 2的主要功能包括:视频问答(能够根据视频内容回答问题),视频字幕生成(自动为视频生成字幕),以及更通用的视频内容分析和理解。它支持自定义数据集的训练和评估,并且提供了详细的安装和使用指南,方便用户快速上手。

如何使用VideoLLaMA 2

使用VideoLLaMA 2需要一定的技术基础。首先,你需要安装必要的依赖项,例如Python、PyTorch和CUDA。然后,从GitHub仓库下载代码,并安装所需的Python包。接下来,准备模型所需的检查点文件(checkpoints),并按照文档说明启动模型服务。你可以使用提供的脚本和命令行工具进行模型的训练、评估或推理。最后,你可以运行在线演示或本地模型服务来体验VideoLLaMA 2的视频理解和生成能力。 根据需要,你可以调整模型参数来优化性能。

VideoLLaMA 2产品价格

目前,关于VideoLLaMA 2的具体价格信息并未公开。建议访问其GitHub页面或联系开发团队获取更多信息。

VideoLLaMA 2常见问题

VideoLLaMA 2的系统需求是什么? 你需要一台具有足够计算能力的电脑,满足PyTorch和CUDA的运行要求。具体的硬件配置要求取决于你所处理的视频大小和复杂度。请参考GitHub上的文档获取详细信息。

如何使用自己的数据集训练VideoLLaMA 2? VideoLLaMA 2支持自定义数据集训练。你需要按照文档说明准备你的数据集,并调整相应的训练参数。GitHub仓库中提供了详细的教程和示例。

VideoLLaMA 2的性能如何? VideoLLaMA 2的性能取决于多个因素,包括数据集、模型参数和硬件配置。其在多选视频问答和视频字幕生成等任务上表现出色,但具体的性能指标需要根据实际应用场景进行评估。 你可以参考GitHub上的评估结果和论文了解更多信息。

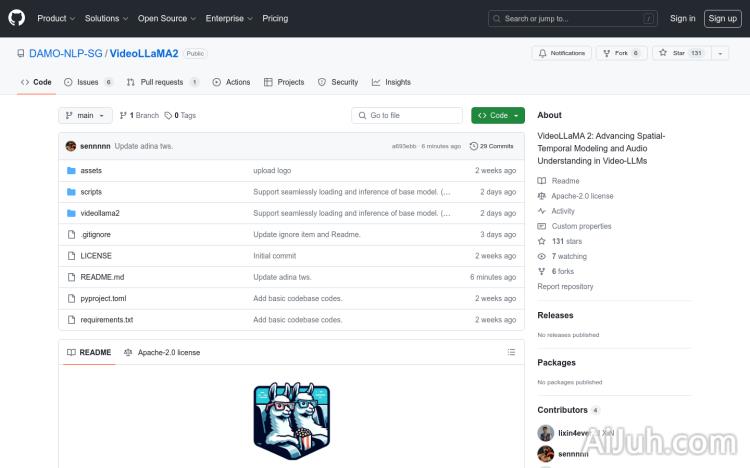

VideoLLaMA 2官网入口网址

https://github.com/DAMO-NLP-SG/VideoLLaMA2

OpenI小编发现VideoLLaMA 2网站非常受用户欢迎,请访问VideoLLaMA 2网址入口试用。

数据统计

数据评估

本站Home提供的VideoLLaMA 2都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由Home实际控制,在2025年 1月 10日 上午7:11收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,Home不承担任何责任。