Infini-attention官网

扩展Transformer模型处理无限长输入

Infini-attention简介

需求人群:

"适用于处理要求对长序列数据进行高效建模和推理的NLP任务。"

使用场景示例:

长文本生成:利用Infini-attention技术生成长篇文章。

密钥检索:在处理长序列密钥上下文块检索任务中应用。

文本摘要:处理长篇文本生成精炼的文本摘要。

产品特色:

压缩记忆机制

局部与长期注意力结合

流式处理能力

支持快速流式推理

模型扩展性

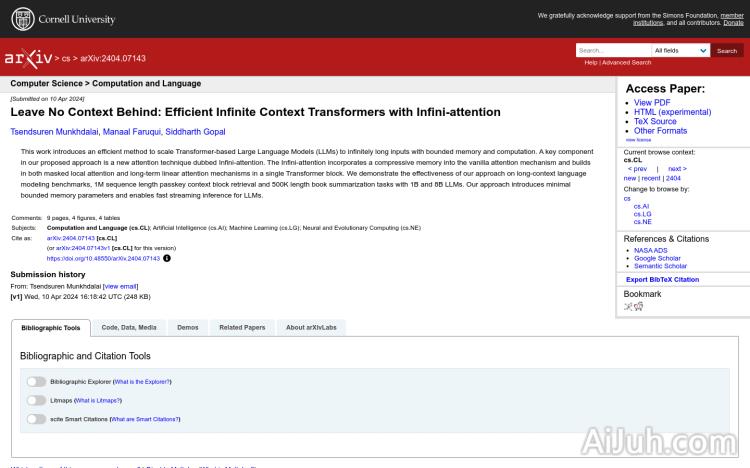

Infini-attention官网入口网址

https://arxiv.org/abs/2404.07143

小编发现Infini-attention网站非常受用户欢迎,请访问Infini-attention网址入口试用。

数据统计

数据评估

关于Infini-attention特别声明

本站Home提供的Infini-attention都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由Home实际控制,在2024年 4月 17日 下午9:39收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,Home不承担任何责任。

相关导航

暂无评论...