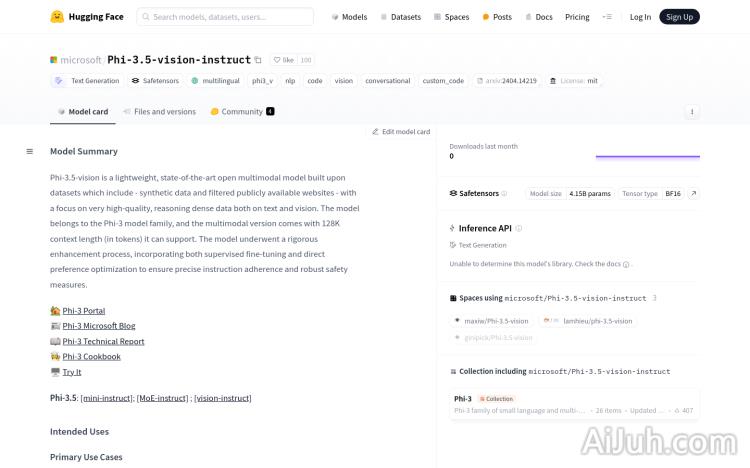

Phi-3.5-vision官网

先进的多模态模型,支持图像和文本理解。

Phi-3.5-vision简介

需求人群:

"目标受众为需要在视觉和文本输入能力方面进行AI系统和应用开发的研究人员和开发者。特别是那些寻求在内存或计算资源受限、对延迟敏感或需要图像理解能力的应用场景中的专业人士。"

使用场景示例:

在办公自动化中,对多页文档进行摘要生成。

在教育领域,对教学幻灯片进行内容分析和知识点提取。

在内容创作中,对图像集合进行比较和故事叙述。

产品特色:

支持多帧图像理解和推理,适用于办公场景。

在单图像基准测试中表现出性能提升,如MMMU和MMBench。

提供多语言支持,但主要针对英语环境设计。

适用于内存/计算受限环境和延迟敏感场景。

支持图像理解、光学字符识别、图表和表格理解。

设计用于加速语言和多模态模型的研究,作为生成式AI功能构建模块。

使用教程:

1. 获取Phi-3.5-vision-instruct模型检查点。

2. 使用提供的示例代码进行推理。

3. 准备图像数据,并将它们加载到模型中。

4. 根据需求构建提示(prompt),例如请求模型对图像进行摘要。

5. 使用模型生成输出,例如文本摘要或图像比较结果。

6. 根据需要调整模型参数,以优化性能和输出质量。

7. 将模型集成到更大的AI应用或系统中。

Phi-3.5-vision官网入口网址

小编发现Phi-3.5-vision网站非常受用户欢迎,请访问Phi-3.5-vision网址入口试用。

数据统计

数据评估

关于Phi-3.5-vision特别声明

本站Home提供的Phi-3.5-vision都来源于网络,不保证外部链接的准确性和完整性,同时,对于该外部链接的指向,不由Home实际控制,在2024年 9月 5日 下午3:55收录时,该网页上的内容,都属于合规合法,后期网页的内容如出现违规,可以直接联系网站管理员进行删除,Home不承担任何责任。

相关导航

暂无评论...